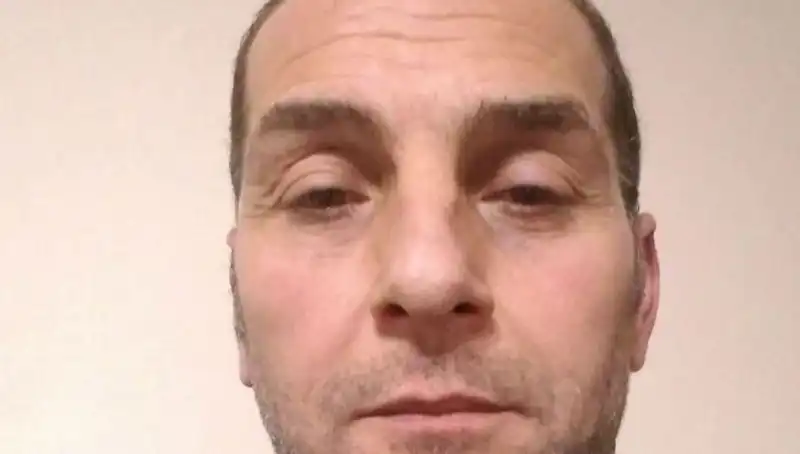

OpenAI CEO'sundan Çarpıcı Uyarı: ChatGPT ile Gizli Bilgilerinizi Paylaşmayın!

OpenAI CEO'su, kullanıcıların ChatGPT ile paylaştıkları bilgilerin gizli kalmayabileceği konusunda uyardı.

OpenAI CEO'su Sam Altman, yapay zeka dil modeli ChatGPT ile kullanıcıların paylaştığı bilgilerin gizliliği hakkında önemli bir uyarıda bulundu. Altman, özellikle kullanıcıların kişisel veya hassas bilgilerini platformda paylaşmamaları konusunda dikkatli olmaları gerektiğini vurguladı. Bu uyarı, dünya genelinde yapay zeka ve veri güvenliği konularında artan kaygıların ortasında gelmesi açısından dikkat çekiyor. Peki, neden böyle bir uyarı gerekli oldu? Ve bu durum kullanıcılar için ne anlama geliyor?

Yapay Zeka ve Veri Gizliliği: Kullanıcılar Ne Kadar Güvende?

Bugün teknoloji dünyasında yapay zeka uygulamaları hızla gelişiyor. ChatGPT gibi dil modelleri, kullanıcılarla etkileşim kurarak onlara bilgi sağlamak ve sorularını cevaplamak için tasarlandı. Ancak bu tür araçların kullanılmasında gizlilik konusu önemli bir etken olarak karşımıza çıkıyor. Sam Altman, kullanıcıların ChatGPT ile paylaştıkları bilgilerin gizli tutulmadığını ve bu bilgilerin çeşitli şekillerde kullanılabileceğini belirtti. Altman'ın açıklamaları, kullanıcıların platformda hangi tür bilgileri paylaşmaları gerektiği hususunda dikkatli olmaları gerektiğini ortaya koyuyor. Elde edilen verilerin, algoritmaların geliştirilmesi ve sistemin iyileştirilmesi amacıyla toplandığı biliniyor. Ancak bu durum, kullanıcıların paylaştıkları kişisel bilgilerin güvenli olup olmadığını sorgulamaya itiyor.

Gizlilik kaygıları, yalnızca kullanıcılar açısından değil, aynı zamanda OpenAI gibi şirketler için de bir sorumluluk konusu haline geliyor. Kullanıcıların güvenini kazanmak ve korumak, teknoloji firmalarının başarısı için kritik bir öneme sahip. Ancak yapay zeka sistemleri, büyük miktarda veri toplayarak çalıştıklarından, bu verilerin nasıl yönetildiği ve korunduğu konusunda net bir politikaya sahip olmak oldukça önemli. Altman, bu noktada kullanıcıların daha dikkatli olması ve özel bilgi paylaşımından kaçınmaları gerektiğini hatırlatıyor.

Kullanıcıların Yapması Gerekenler: Bilinçli ve Dikkatli Olun

OpenAI'nın CEO'sunun uyarısı, kullanıcılar açısından harekete geçirmesi gereken önemli bir uyarı niteliği taşımaktadır. Kullanıcıların, ChatGPT gibi yapay zeka tabanlı hizmetleri kullanırken nelere dikkat etmeleri gerektiği konusunda bilgi sahibi olmaları gerekiyor. Öncelikle, kullanıcıların platformda kişisel bilgilerini, finansal verilerini veya diğer hassas bilgilerini paylaşmamaları önem arz ediyor. Bu, sadece ChatGPT için değil, diğer birçok dijital platform ve uygulama için geçerli bir kuraldır.

Ayrıca, kullanıcıların en azından temel veri gizliliği hakkında bilgi sahibi olmaları önemlidir. Kullanıcı sözleşmelerini okumak, veri toplama ve gizlilik politikalarını incelemek gibi adımlar, bilinçli bir dijital deneyim için gereklidir. Altman’ın vurguladığı gibi, kullanıcıların kendi bilgilerinin kontrolünü elinde tutması ve hangi bilgileri paylaşacaklarına dikkat etmeleri gerekiyor. Bu kaygılar, kullanıcıların yapay zeka ile etkileşimde bulunurken daha duyarlı ve dikkatli olmalarını sağlayabilir.

Son olarak, yapay zeka teknolojilerinin geleceği, kullanıcıların bu sistemlerle olan etkileşimlerine bağlı olarak şekillenecektir. OpenAI gibi firmalar, kullanıcıların güvenliğini sağlamakla yükümlüdür, ancak bu süreçte kullanıcıların da bilinçli ve dikkatli olması son derece önemlidir. Sam Altman’ın uyarısı, teknoloji dünyasında daha geniş bir tartışmanın kapısını aralayarak, veri gizliliği ve yapay zeka etkileşimleri hakkında daha fazla düşünmeye teşvik ediyor.

Yani, yapay zeka ile iletişim halinde olmak artık günlük yaşamımızın bir parçası haline geldi. Ancak, bu etkileşimlerin güvenli bir şekilde gerçekleşmesi ve kullanıcıların gizliliğinin korunması adına dikkatli olmaları gerektiği unutulmamalıdır. OpenAI CEO’sunun yaptığı bu kritik uyarı, yalnızca bir uyarıdan ibaret değil; aynı zamanda kullanıcıların bilinçlenmesi ve teknoloji dünyasında daha güvenli bir deneyim elde edebilmesi için bir çağrıdır.